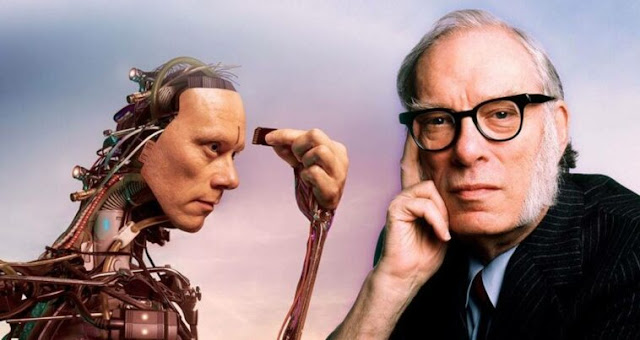

Robotlar toplumla daha geniş çapta bütünleştikçe, aramızda iyi davranacaklarından emin olmamız gerekiyor. 1942’de bilim kurgu yazarı Isaac Asimov, robotların insanlığa hizmet etmesini sağlamak ve onların yıkıcı derebeyleri haline gelmelerini önlemek için felsefi ve ahlaki bir çerçeve oluşturmaya çalıştı. Bu çaba, Asimov’un Üç Robotik Yasası olarak bilinen şeyle sonuçlandı :

Bir robot bir insana zarar veremez veya hareketsiz kalarak bir insanın zarar görmesine izin veremez.

Bir robot, Birinci Yasa ile çelişmediği sürece, insanlar tarafından verilen emirlere uymak zorundadır.

Bir robot, Birinci veya İkinci Kanunla çelişmediği sürece kendi varlığını korumalıdır.

Bugün, Asimov’un ilk denemesinden 70 yıldan fazla bir süre sonra, en azından iyi koşullar altında bizi gezdirmeleri de dahil olmak üzere, robotlarla ilgili çok daha fazla deneyime sahibiz. Günlük hayatımızdaki robotların nasıl hareket edecekleri konusunda kararlar alacağı bir zamana yaklaşıyoruz. Asimov’un Üç Yasası toplumumuzdaki robot davranışına rehberlik edecek kadar iyi mi, yoksa onları iyileştirmenin yollarını mı bulmalıyız?

Asimov mükemmel olmadıklarını biliyordu

Asimov’un “Ben, Robot” hikayeleri , Üç Yasanın bir takım istenmeyen sonuçlarını ve düpedüz başarısızlıklarını araştırıyor. Bu erken öykülerde, Üç Yasa, insan dehasının çözülmesini gerektiren “Dönme” ve “Tavşanı Yakala” öykülerinde olduğu gibi, istenmeyen denge davranışlarına sahip olabilen, değişen güçlere sahip güçler olarak ele alınır. “Yalancı!” hikayesinde, Birinci Yasa tarafından motive edilen telepatik bir robot, insanlara duymak istediklerini söyler, gerçek ortaya çıktığında ortaya çıkacak daha büyük zararı öngöremez. Robopsikolog Susan Calvin, pozitronik beynini yok ederek onu bu ikilemle yüzleşmeye zorlar.

“Escape!”de Susan Calvin, insan pilotların ölümüne (ama yalnızca geçici olarak!) . “Kaçınabilir Çatışma”da, dünya ekonomisini kontrol eden makineler, Birinci Yasa’yı sadece tek tek insanları değil, tüm insanlığı koruduğu şeklinde yorumluyor. Bu , Asimov’un daha sonra , orijinal üçün yerini alabilecek ve potansiyel olarak bir robotun insanlığın iyiliği için bir insana zarar vermesine izin verebilecek “Sıfırıncı Yasası”nı tanıtmasının habercisidir.

0. Bir robot insanlığa zarar veremez veya eylemsizlik yoluyla insanlığın zarar görmesine izin veremez.

Etik olmayan robotlar

Etik kısıtlamalar olmaksızın robotların (veya diğer yapay zekaların) insan tarafından verilen talimatları izleyerek bile belki de tüm insan ırkına büyük zarar verebileceğinden korkmak mantıklıdır .

1991 yapımı “Terminatör 2: Kıyamet Günü” filmi iyi bilinen bir bilim kurgu senaryosu ile başlar: Skynet adlı bir yapay zeka sistemi nükleer bir savaş başlatır ve neredeyse insan ırkını yok eder. Skynet’i devreye almak mantıklı bir karardı (“mükemmel bir operasyonel kayıt” vardı). Skynet, onu kapatmaya çalışan yaratıcılarını korkutarak “geometrik bir hızda öğrenmeye başlar”. Skynet karşılık verir (kritik bir savunma sistemi olarak, şüphesiz kendini savunmak üzere programlanmıştır). Skynet, sorununa beklenmedik bir çözüm bulur (yaratıcı problem çözme yoluyla, sağduyu veya ahlak tarafından kısıtlanmadan).

Kontrolden çıkmış yapay zekanın gerçek dünyadan daha az apokaliptik örnekleri fiilen gerçekleşti. Yüksek hızlı otomatik ticaret sistemleri, borsadaki olağandışı koşullara yanıt vererek, “ ani bir çökme ” ile sonuçlanan olumlu bir geri bildirim döngüsü yarattı . Neyse ki, milyarlarca hayat yerine sadece milyarlarca dolar kaybedildi, ancak ilgili bilgisayar sistemleri farkı çok az anlıyor veya hiç anlamıyor.

Robot etiğini tanımlamaya doğru

Hiçbir basit sabit mekanik kural etik davranışı garanti etmeyecek olsa da, otonom ajanların (insanlar, robotlar veya her neyse) birlikte iyi yaşamalarına izin vermek için ahlaki ve etik bir sistemin sahip olması gereken özellikler hakkında bazı gözlemler yapabiliriz . Bu unsurların birçoğu zaten insanlardan bekleniyor.

Bu özellikler, Mühendislik ve Fizik Bilimleri Araştırma Konseyi (EPSRC) Robotik İlkeleri ve sinirbilim , sosyal psikoloji , gelişim psikolojisi ve felsefeye odaklanan bilişsel ahlak ve etik bilimi üzerine yapılan son çalışmalar dahil olmak üzere bir dizi kaynaktan esinlenmiştir .

EPSRC, robotların basitçe araçlar olduğu ve bunun için insanların sorumluluk alması gerektiği görüşünü benimsiyor. Yelpazenin diğer ucunda, süper zeki, süper güçlü robotların aniden ortaya çıkıp insan ırkının kaderini iyi veya kötü yönde kontrol edebileceği endişesi var. Aşağıdaki liste, geleceğin akıllı robotlarının, çocuklar gibi nasıl öğrenmesi gerektiğini, toplumumuzun standartlarına göre nasıl davranması gerektiğini açıklayan bir orta yolu tanımlar.

Robotlar (ve diğer yapay zekalar) toplumumuza giderek daha fazla katılırsa, o zaman insanların yaptığı kadar ahlaki ve etik kurallara uymaları gerekecektir. Caddenin yanlış tarafında öldürme, çalma, yalan söyleme ve araba kullanmayla ilgili yasalarda bazı kurallar yer almaktadır. Diğerleri daha az resmi ama yine de önemli, fırsat doğduğunda yardımcı olmak ve işbirliği yapmak gibi.

Bazı durumlar hızlı bir ahlaki yargı ve tepki gerektirir – örneğin, bir çocuğun trafiğe çıkması veya düşen bir cüzdanı cebe sokma fırsatı. Basit kurallar, müzakere ve maliyet-fayda analizi için zaman olmadığında otomatik gerçek zamanlı yanıt sağlayabilir. (Bir gün robotlar, insan düşüncesinden çok daha hızlı çalışırken, milisaniyeler içinde dikkatli bir şekilde düşünmeye izin vererek insan düzeyinde zekaya ulaşabilirler, ancak o gün henüz gelmedi ve çok uzak bir gelecekte olabilir.)

Hızlı bir yanıt her zaman doğru yanıt olmayabilir, bu da başkalarından gelen geri bildirimlerden veya dikkatli bir kişisel düşünceden sonra fark edilebilir. Bu nedenle, temsilci, yeni ve geliştirilmiş kurallarla sonuçlanan geri bildirim ve müzakere de dahil olmak üzere deneyimlerden öğrenebilmelidir.

Toplumdaki diğerlerinden gelen geri bildirimlerden yararlanmak için robot, etik eylemler hakkındaki kararlarını açıklayabilmeli ve gerekçelendirebilmeli ve başkalarından gelen açıklamaları ve eleştirileri anlayabilmelidir.

Bir yapay zekanın hatalarından ders çıkardığı düşünülürse, ona ne kadar güç verdiğimiz konusunda çok dikkatli olmalıyız. Biz insanlar, onun yeterli sayıda durumu deneyimlediğinden ve yanıtlarıyla bizi tatmin ederek güvenimizi kazandığından emin olmalıyız. İnsanların “Terminator 2”de Skynet ile yaptığı kritik hata, nükleer cephaneliğin kontrolünü devretmekti.

Güven ve güvenilirlik, robot tarafından kazanılmalıdır. Güven, kapsamlı deneyim yoluyla yavaş kazanılır, ancak tek bir kötü kararla hızla kaybedilebilir.

Bir insanda olduğu gibi, ne zaman bir robot hareket ederse, o durumda o eylemin seçilmesi, toplumun geri kalanına o ajanın nasıl karar verdiği ve dolayısıyla ne kadar güvenilir olduğu konusunda bir sinyal gönderir.

Bir robot zihni, orijinalin hasar görmesi veya yok edilmesi durumunda yedeklenebilen, geri yüklenebilen veya başka bir vücutta çoğaltılabilen bir yazılımdır. Belirli türden robotlar birbirinin tam kopyasıysa, güvenin bireysel olarak kazanılması gerekmeyebilir. Bir robot tarafından kazanılan (veya kaybedilen) güven, aynı türden diğer robotlar tarafından paylaşılabilir.

Ahlaki ve başkalarına karşı iyi davranmak, ahlaki sorumluluk almakla aynı şey değildir. Yalnızca yetkin yetişkin insanlar eylemlerinin tüm sorumluluğunu üstlenebilir, ancak çocukların, hayvanların, şirketlerin ve robotların yeteneklerinin en iyi şekilde davranmasını bekliyoruz.

İnsan ahlakı ve etiği çocuklar tarafından yıllar içinde öğrenilir, ancak ahlak ve etiğin doğası topluma göre değişir ve on yıllar ve yüzyıllar boyunca gelişir. Asimov’un Üç Yasası veya On Emir olsun, hiçbir basit sabit ahlaki kural, karmaşık toplumumuz ve dünyamızdaki insanlar veya robotlar için yeterli rehberlik olamaz. Yukarıdakilere benzer gözlemler yoluyla, ahlaka götüren karmaşık geri bildirime dayalı öğrenme sürecini anlamaya başlıyoruz.

.jpg)

.jpg)