1917’de, kişisel kameraların piyasaya sürülmesinden kısa bir süre sonra, dünya, küçük çocukların perilerle oynadığını gösterdiği iddia edilen fotoğrafların yayınlanmasıyla sarsıldı. Cottingley Perileri, bilindiği gibi, bir dizi uzman tarafından meşru kabul edildi ve Arthur Conan Doyle’dan başkası tarafından popülerleştirilmedi. Yıllar sonra, fotoğraflardaki çocuklar, şimdi yetişkinler, kağıt kesiklerle yapılmış sahte olduklarını itiraf ettiler. İster sanat, ister sahtekarlık, ister kontrolden çıkmış hayali bir şaka olsun, neredeyse elimizden geldiğince uzun süredir gerçekliğin yanlış bir resmini çizmek için görüntüleri değiştiriyoruz.

Hayal gücümüzden görüntüler yaratma becerimiz ve eğilimimiz, pratik efektler, kamera hileleri ve post prodüksiyon değişiklikleri kullanan gelişen televizyon ve film endüstrilerine kendini ödünç verdi. Görüntüleme teknolojilerimiz giderek daha fazla dijital hale geldikçe, bu, görüntüleri tahrif etmek için yeni bir alan açtı ve bu araçlar giderek daha geniş bir kitle tarafından kullanılabilir hale geldi. Sahte görüntüler yaratma yeteneği yayıldıkça, toplum biraz kalp ağrısına mahkum oldu.

Şimdi, sofistike ancak hazır yazılımların kullanımıyla, neredeyse zamanı ve yeteneği olan herkes, hemen hemen herkesin fabrikasyon görüntülerini veya videolarını oluşturabilir. Bu, bir gün yakında – belki de şimdiden – çevrimiçi gördüğümüz ve duyduğumuz şeylere güvenemeyeceğimizden endişe ediyor.

Terimleri tanımlamak, derin sahte nedir?

“Derin sahte” terimi, manipüle edilmiş herhangi bir görüntü için bir tür genel durum haline geliyor, ancak bu tam olarak doğru değil. Bir şeyin derin sahte olması için gereken birkaç kriter var, video olmalı ve işin içinde bir yapay zeka olmalı. “Derin sahte” içindeki “derin”, değiştirilmiş video üretiminde yer alan derin öğrenme algoritmalarını ifade eder.

Özünde, hiç olmamış ( Business Insider aracılığıyla ) ikna edici görselleri değiştirmek veya oluşturmak için yapay zeka (bazen birden fazla) kullanan herhangi bir videoyu ifade eder. Varsayımsal olarak bir yapay zekayı sandalyeleri tanıması ve onları puflarla değiştirmesi için eğitebilir. Biri sadece hayal gücü, arzu ve algoritmalarının yeteneği ile sınırlıdır. Etkileri geniş kapsamlı olsa da, teknoloji çoğunlukla yüzler için kullanılıyor ve genellikle ünlüler veya politikacılar gibi tanınmış kişileri hedef alıyor.

Belli bir bakış açısından, çoğumuz her gün basit derin sahtelerle etkileşime giriyor ve oluşturuyoruz. Forbes tarafından açıklandığı gibi, Snapchat veya TikTok’unuzdaki filtreler, sizi bir köpeğe dönüştürmek veya yüzünüze çil ve makyaj eklemek için aynı yüz tanıma ve yapay zekadan bazılarını kullanır.

İlk GAN (Generative Adversarial Network)

Her biri kendine özgü iş türü için uzmanlaşmış her türlü yapay zeka vardır. Bazıları konuşmayı tanımada ve ilgili yanıtları geri vermede iyidir. Diğerleri çevreyi tanımakta ve içinde gezinmekte iyidir. Bu tür AI, insanların davranışlarını makul bir dereceye kadar kopyalamak için mevcut insan bilgisine veya yaratılışına dayanır. Bir sonraki belirgin adım, yeni şeyler yaratabilen yapay zeka yaratmaktı.

2014 yılında, Ian Goodfellow ve ortak yazarlar, üretken AI eğitimi için yeni bir çerçeve önerdiler. Generative Adversarial Networks veya GAN adı verilen sistemleri Arxiv ön baskı sunucusunda yayınlandı. Sinir ağlarının öncülü nispeten sezgiseldir. İki bilgisayar modelini karşı karşıya getirerek çalışır. İlk model, ona ne söylerseniz onu üretir. Harfler ve sayılar olabilir veya insan yüzleri olabilir. İkinci model, oluşturulan görüntünün benzersiz mi yoksa eğitim verilerinden alınan gerçek bir görüntü mü olduğuna inandığına karar verir.

Ayırt edici model, üreten modelin yaratılışını belirlemede başarılı olursa, o zaman üreten model çizim tahtasına geri döner. Tekrar eder ve tekrar dener. Eşleştirilmiş bilgisayar modellerinin düşmanca doğası, yaratıcı bir silahlanma yarışına neden olarak, üretken yarıyı sürekli olarak daha inandırıcı sahtekarlıklara doğru yönlendirir. Gerçek görüntüler üzerinde eğitim alma ve ardından inandırıcı tıpkıbasımlar oluşturma yeteneği, derin sahtekarlık ortaya çıktıkça paha biçilmez olacaktır.

Filmlerde yaşlanma ve yüz değişimi

Goodfellow’un ilk GAN’ları icat ettiği sıralarda, Lucasfilm’deki insanlar Skywalker’larla doğrudan ilgili olmayan ilk “Yıldız Savaşları” filmi üzerinde çok sıkı çalışıyorlardı. “Rogue One” sinemalarda gösterime girdiğinde, hayranlar serinin ilk bölümünden iki tanınmış karakterle yeniden tanıştırıldı. Hem Grand Moff Tarkin hem de Prenses Leia ekrana geri döndü, ancak orijinal oyuncuların hiçbiri – sırasıyla Peter Cushing ve Carrie Fisher – rollerini yeniden canlandıramadı.

Bunun yerine, film yapımcıları, kameranın önünde genç bir Peter Cushing veya Carrie Fisher varmış gibi görünmesi için diğer oyuncuların canlı performanslarına ve post prodüksiyon film büyüsüne güvendiler. Süreç, doğru aktörü, benzer yüz özelliklerine sahip birini ve replikleri doğru kadansta iletme becerisini seçerek başladı.

Oradan film yapımcıları, hareketlerini yapmak ve olaydan sonra onları değiştirmek için yüzdeki noktalardan yararlanan hareket yakalama teknolojisini kullandılar. Son olarak film yapımcıları, istenen yüzü performansla eşleştirmek için hareket yakalama ve özel efektlerden gelen verileri kullanır. “Rogue One” çıktığında, derin sahtekarlık kavramı henüz kamuoyunun bilincine girmemiş olsa da, birçok izleyiciye ufuktaki teknolojik değişime ilk bakışını verdi.

Derin sahte teriminin kökeni

Modern tabirle, “derin sahte” terimi kendi başına bir hayat kazanmıştır. Çoğumuz bu terimi nereden geldiğini hiç düşünmeden kullanırız. Bu sorunun aslında iki cevabı var. Birincisi basit ve etimolojiktir. Adı, ilgili derin öğrenme algoritmalarından “derin” alan ve bariz bir nedenle “sahte” olan bir portmanteau’ya atıfta bulunur ( Grammarist aracılığıyla ). Tarihsel olarak, başka bir kökeni vardır.

2017 yılında, Deepfakes adlı bir Reddit kullanıcısı, görünüşte tanınmış ünlüleri içeren değiştirilmiş pornografik videolar yüklemeye başladı. Belki de ünlülerin yüzlerini durağan pornografik görüntülere dönüştürmek için yerleşik uygulamanın doğal ve hatta beklenen bir sonucuydu, ancak bu kimsenin buna hazırlıklı olmadığı anlamına gelmiyor.

Vice’a göre, Deepfakes kreasyonları belirli alt dizinlerde bir hit oldu ve ortaya çıkan medyanın ilgisi, derin sahtekarlık kavramını halkın gözüne sokmaya yardımcı oldu. Vice ile yaptığı bir konuşmada Deepfakes, Google’da, stok fotoğraf havuzlarında ve YouTube videolarında bulunan herkese açık görselleri kullandıklarını belirtti. Daha sonra yapay zekayı hedef medya, bu durumda seçilen ünlünün pornografik videoları ve görüntüleri konusunda eğittiler. Deepfakes’e göre sistem, hedef yüzü tanıyarak ve diğer görüntüleri o yüzün çarpıklıkları olarak ele alarak çalıştı. Algoritma istenen bileşenleri iyi bir şekilde ele aldığında, bir ünlünün yüzünü yetişkin bir film yıldızının vücuduna, herkesin şaşkınlığına ve dehşetine göre haritalayabiliyordu.

Adobe her şeyi söylemenize izin verir

2016’da bir basın etkinliği sırasında Adobe, Photoshop’un durağan görüntüler için yaptığını ses için yapmayı vaat eden VoCo adlı yeni bir yazılımı duyurdu ( Vice aracılığıyla ). Yazılım, bir kişinin sesinin bir modelini oluşturmak için yalnızca yaklaşık 20 dakikalık örnek sese ihtiyaç duyar. Kamuya mal olmuş kişiler, herkesin yeterince örnek sesi bir araya getirmesi için konuşmalardan, röportajlardan ve ekran performanslarından, radyo ve podcast’lerden bahsetmiyorum bile, sayısız saat sesine sahiptir. Aslında, çoğumuz 20 dakikadan fazla kendi sesimizi internete koyarak hepimizi potansiyel hedef haline getirdik.

Ardından, bu az miktarda eğitim sesini kullanarak, kullanıcı sadece söylemek istediğiniz şeyi yazarak hedef sesle konuşulan yeni ses üretebilir. Gösteride, Adobe’den Zeyu Jin, bir ödül hakkında konuşan Keegan Michael Key’den bir ses parçası alıyor. Jin daha sonra belirli kelimeleri yeniden sıralar veya değiştirir. Son olarak, Jin cümlenin bir bölümünü keser ve yerine tamamen yeni kelimeler koyar.

Sonuç, asla söylemedikleri kelimeleri söyleyen bir halk figürünün ses dosyasıdır. Neyse ki Adobe, dosyalara filigran eklemeyi veya başka bir şekilde tanımlanabilir hale getirmeyi düşündü.

Yüz2Yüz

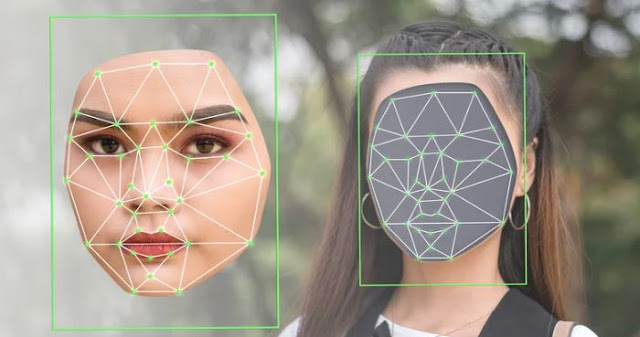

Aralık 2018’de Almanya ve Amerika Birleşik Devletleri’nden araştırmacılar, ACM Communications dergisinde yayınlanan bir makalede Face2Face’i ortaya çıkardı. İçinde, bir videonun ifadesini ve ağız hareketlerini değiştirmek için yüz yakalama kullanan bir süreci tanımlar ve gösterirler.

Face2Face, etkisini elde etmek için iki video akışı kullanır. Birincisi değiştirmek istediğiniz hedef video, ikincisi sizin veya bir oyuncunun istediğiniz değişiklikleri canlandırdığı bir video. Yazarlara göre, hedef video YouTube gibi herhangi bir kamu kaynağından alınabilir ve ikinci video bir web kamerası kullanılarak yakalanabilir.

Kameranızı açtıktan sonra, sistem yüz hareketlerinizi takip eder ve deformasyon aktarımı yoluyla bunları hedef videoya eşler. Oyuncu, hedefin sesi hakkında iyi bir izlenim bırakırsa, ihtiyacınız olan tek şey budur, ancak buna gerçekten ihtiyacınız bile yoktur. Adobe’nin VoCo’su ile birleştiğinde, içerik oluşturucular, bir kişinin istediğini söyleyen sesini oluşturabilir, ardından bunu sahte bir Face2Face videosuyla eşleştirerek, bir başkasının hareketlerini ve konuşmasını bir kukla gibi kontrol etmenize olanak tanır.

DerinYüzCanlı

Çoğunlukla, çok yakın zamana kadar derin sahtekarlıklar oluşturmak, mevcut videonun alınmasını ve eğitim videosu ve yapay zekanın kullanılmasıyla manipüle edilmesini içeriyordu. Today ile yapılan bir röportajda, deeptomcruise’ın arkasındaki viral TikTok yaratıcıları, TikTok için bir klip çekmenin bir hafta veya daha fazla sürdüğünü belirtti. Bir yıl sonra, sadece günler sürer. Teknoloji ilerledikçe, DeepFaceLive’ın piyasaya sürülmesiyle kanıtlandığı gibi, derin sahte oluşturma süreci yalnızca daha hızlı ve daha erişilebilir hale gelecektir.

2021’de Github’da yayınlanan ve diğer derin sahte araçlarda yer alan Rus geliştirici Iperov tarafından oluşturulan açık kaynaklı bir araçtır. Daily Dot’a göre, tanınmış kişilerin benzerliklerini toplamak için daha önce var olan derin sahtecilik araçlarıyla aynı eğitim video veri kümelerini kullanıyor, ancak gerçek zamanlı olarak çalışıyor.

Teknoloji, Snapchat veya TikTok’tan aşina olabileceğiniz filtrelere benzer, ancak sizi bir köpeğe dönüştürmek yerine bir ünlüye dönüştürebilir. Araç ayrıca Zoom veya Skype gibi yaygın video akış yazılımlarıyla da uyumludur ve potansiyel olarak kullanıcıların canlı görüntülü aramalar sırasında diğer kişiler gibi poz vermelerine olanak tanır.

Ay Felaketi Durumunda

Bu teknolojilerin bir arada nasıl kullanılabileceğine dair bariz endişeler var – zaten nasıl kullanıldıklarından bahsetmiyorum bile – tamamen kurgusal ama tamamen ikna edici videolar oluşturmak için. Ancak bu teknolojileri ahlaki açıdan daha az kirli bir şekilde kullanabilecek eğitim ve eğlence uygulamaları da var.

Bunun nasıl yapıldığını görmek için, aklımızda Apollo programının zirvesine geri dönmemiz gerekecek. 1969’da Neil Armstrong, Buzz Aldrin ve Michael Collins Ay’a tehlikeli bir yolculuk yaparken, Birleşik Devletler siyasi liderleri iki olası olasılığa hazırlanıyorlardı. Bir yandan, Başkan Nixon hepimizin duyduğu, Ay’a başarılı bir görevden bahseden konuşmayı taşıdı. Yine de, başarısızlığı ve trajediyi dünyaya evden uzakta ( MIT aracılığıyla ) bildiren başka bir konuşma vardı.

” In Event of Moon Disaster ” ın arkasındaki kişiler, Apollo XI trajediyle sona ermiş olsaydı dünyanın nasıl görünebileceğini göstermek istediler ve ayrıca izleyiciye açıkça kurgusal bir şey izlediklerini söylediler. Bu sekiz dakikalık kısa film, izleyicileri derin sahtekarlıkların gücüyle alternatif bir tarihe götürüyor.

Bir aktör, doğru ritmi elde etmek için Nixon’ın asla vermediği konuşmayı okudu. Daha sonra konserde video ve ses manipülasyonu kullanıldı, öyle ki aradan yarım yüzyıl geçmesine rağmen Nixon konuşmayı yapıyor gibi görünüyor.

Her altı ayda bir ikiye katlanıyor

Çok uzun zaman önce, derin sahtekarlıklar, ilgilendiklerinden daha ilginçti. Gelecekteki potansiyelleri korkutucu olsa da, bir korku filmi izlemekten alacağınız türden bir korkuydu.

Araçlar yaptıkları işte daha iyi hale geldikçe ve daha yaygın olarak kullanılabilir hale geldikçe, çok sayıda derin sahtekarlığın patlaması muhtemeldir. Aslında, Discover Magazine’e göre, 2018’den beri derin sahtekarlıkların yayılmasını izleyen bir şirket olan Sensity tarafından yayınlanan raporlar, oluşturulan toplam derin sahtekarlık sayısının her altı ayda bir kabaca ikiye katlandığını gösteriyor.

Bunlardan bazıları – yukarıda bahsedilen deeptomcruise videoları gibi – eğlenceli ve muhtemelen zararsız olsa da, büyük çoğunluğu derin sahtekarlığın köklerinden çok uzaklaşmadı. Sensity’ye göre, oluşturulan deepfake’lerin kabaca %96’sı pornografi içindir.

Derin sahtelerin gelişme ve yayılma hızı, işlerin her iki yılda bir kabaca ikiye katlandığı diğer teknolojik alanlardaki büyümeyi önemli ölçüde aşıyor ( Our World in Data aracılığıyla ). Çok geçmeden neyin gerçek neyin gerçek olmadığını ayırt etmek zorlaşabilir.

İşler göründüğü kadar kötü değil

Şimdilik, derin bir sahtekarlığın konusu olma riski, büyük ölçüde siyasi şahsiyetlere ve ünlülere tecrit edilmiş durumda. Gördüğümüze ve duyduğumuza güvenme yeteneğimizi kaybetme riski olsa da, ortalama bir insanın kötü niyetli bir derin sahtekarlığın kurbanı olması pek olası değildir. Bu türümüz hakkında ne söylerse söylesin, derin sahte içeriğin ezici çoğunluğu doğada pornografik kalır ve bu da potansiyel hedeflerin kapsamını sınırlar. Bununla birlikte, derin sahtekarlıkların büyümesi göz önüne alındığında, sonunda bu kapsam genişleyebilir.

Neyse ki, her şey kaybolmadı. İçerik oluşturucular teknolojinin yapabileceklerinin sınırlarını zorlarken, araştırmacılar yeni algılama yöntemleri geliştiriyor. Proceedings of the National Academy of Sciences’da yapılan bir araştırmaya göre, yakın zamana kadar önde gelen tespit teknolojileri, derin bir sahtekarlığı yaklaşık %65’inde başarılı bir şekilde tespit edebiliyordu. Belirli koşullar altında, insanlar biraz daha iyi performans gösterir. Yeni araştırmalar açığı kapatabilir.

UC Riverside’daki araştırmacılar, derin sahtekarlıkları yaklaşık %99 doğrulukla tespit edebilen bir yöntem geliştirdi. Yalnızca tüm bir yüzün ne zaman değiştirildiğini değil, aynı zamanda ifadelerin ne zaman manipüle edildiğini de algılayabilir. Yüzün hangi bölümlerinin değiştirildiğini bile belirleyebilir. Tabii ki, yalnızca onları aramayı biliyorsanız ve doğru araçlara sahipseniz sahteleri tespit edebilirsiniz. Derin sahteler hayatımızın giderek artan bir parçası haline geldiğinden hepimizin uyanık kalması gerekecek.